AI、医師の診断能力を上回る可能性

新しい研究で、OpenAIのLLM(大規模言語モデル)であるo1モデルが、緊急病棟(ER)での医師の診断能力を上回ることが示された。

患者の症状に関する情報を基に、モデルは心臓の血流低下などの重篤な疾患を、医師よりも高い精度で診断した。

特に初期段階での診断において、モデルは67%の精度で正確な診断を下したのに対し、医師は50~55%だった。

研究者は、実際の医療現場での利用には信頼性の高い状況を特定する必要があるとしつつも、AIが医療現場に革命をもたらす可能性を示唆している。

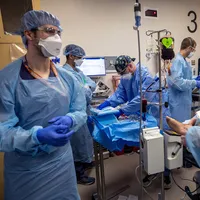

AIが医師の診断能力を上回る可能性が示されています。最新の研究によると、大規模言語モデル(LLM)が、心臓への血流減少などの重篤な病状を、実際の救急外来(ER)の現場で高い精度で診断できることが報告されました。これは、医療現場におけるAIの役割が、単なる補助ツールから、診断の主要な担い手へと変化しつつあることを示唆しています。

LLMが示す高い診断精度

研究チームは、OpenAIのo1といった高度なLLMを用いて、様々な病状を持つ患者の診断精度を検証しました。その結果、o1は手選定された医療プロファイルに基づき診断を提案するタスクにおいて、医師と同等かそれ以上の性能を発揮しました。特に、診断的思考や次のステップの提案といった臨床推論の質においては、o1が98%のケースで完璧なスコアを記録したのに対し、担当医は35%に留まっていたというデータも報告されています。これは、AIが持つ論理的推論能力の高さを示しています。

リアルなER環境での性能検証

さらに重要なテストとして、研究では実際のER患者のケースを使用し、患者の受付から医師による評価、最終的な治療方針決定までの3段階のケアプロセスをシミュレーションしました。この過程は、情報が不完全であったり、ストレス下で迅速な判断が求められる「現実の現場」を再現しています。初期のトリアージ段階、つまり情報が限られている段階で、o1は正確または非常に近い診断を67%の確率で特定しました。これは、同条件で評価された医師の精度(50〜55%)を大きく上回る結果でした。

実用化に向けた課題と展望

一方で、専門家からはAIの医療利用にはいくつかの課題が指摘されています。現在の研究は、数時間程度の短期的なER滞在を対象としており、長期的な病歴を必要とする入院患者への適用可能性は低いと警告されています。また、本研究では画像診断などの非テキストデータが使用されていなかった点も、実際の診断プロセスとのギャップとして挙げられています。今後は、より広範で長期的な情報を扱うモデルの開発が求められています。

結論

AIが医療診断の分野で目覚ましい進歩を遂げていることは間違いありません。しかし、この技術を実際の患者ケアに組み込むためには、データの質や量、そして様々な臨床的文脈での信頼性を深く理解し、実用化に向けたさらなる検証が必要とされています。

原文の冒頭を表示(英語・3段落のみ)

If you walk into an emergency room (ER) in 10 years, you’ll encounter a new type of caregiver: an artificial intelligence (AI) system designed to get you a diagnosis faster and help your care team make more informed decisions. While you sit in the waiting room, you’ll be hooked up to a blood pressure cuff that’s constantly and autonomously monitored. All the while, an AI agent will be listening in while you and your doctor talk about your symptoms, ready to flag any mistakes your physician makes or suggest next steps.

This vision of AI-assisted emergency health care may soon be reality. In a new study, researchers show that a type of AI known as a large language model (LLM) often outperformed physicians at diagnosing complex and potentially life-threatening conditions, including decreased blood flow to the heart, even in the fast-moving stages of real ER care when information is limited, they report today in Science. In early ER cases, the model identified the correct or a very close diagnosis in about 67% of cases, compared with roughly 50% to 55% for physicians. And the technology is only getting better.

“Evaluating AI in medicine demands both depth and breadth across different clinical tasks and settings,” and these authors were able to incorporate both in this study, says Shreya Johri, a computer scientist at the Dana-Farber Cancer Institute who was uninvolved with the new research. Still, she notes, wide adoption of these AI systems in health care will hinge on knowing the contexts in which they’re most reliable.

※ 著作権に配慮し、引用は冒頭3段落までです。続きは元記事をご覧ください。